Durchsuchen Sie den vollständigen Text des KI-Gesetzes online mit unserem AI Act Explorer

EU AI Act Compliance Checker

Mit dem EU-KI-Gesetz werden bald neue Verpflichtungen eingeführt. Nutzen Sie unser interaktives Tool, um festzustellen, ob Ihr KI-System davon betroffen ist oder nicht.

Wenn Sie über Ihre Verpflichtungen im Rahmen des EU AI Act auf dem Laufenden bleiben möchten, empfehlen wir Ihnen, den EU AI Act Newsletter zu abonnieren.

Um mehr Klarheit zu schaffen, empfehlen wir Ihnen, sich rechtlich beraten zu lassen und die nationalen Richtlinien zu befolgen. Weitere Informationen über die Durchsetzung des EU-AI-Gesetzes in Ihrem Land werden voraussichtlich im Jahr 2024 zur Verfügung gestellt.

Bitte beachten Sie: Der EU AI Act wird noch verhandelt. Dieses Tool ist daher nur unsere beste Einschätzung der rechtlichen Verpflichtungen, die Sie nach der endgültigen Gesetzgebung haben könnten. Wir werden das Tool weiterhin aktualisieren, um etwaige Änderungen an dem vorgeschlagenen Gesetz zu berücksichtigen.

Feedback - Wir arbeiten an der Verbesserung dieses Tools. Bitte senden Sie Ihr Feedback an Risto Uuk unter risto@futureoflife.org

11. März 2024 - Aktualisiert, um den "endgültigen Entwurf" des AI-Gesetzes wiederzugeben.

Änderungsliste

26. März 2024

- Es wurde ein Fehler behoben, der verhinderte, dass die Einsatzkräfte ihre Verpflichtungen gemäß Artikel 29 erfüllen konnten.

- Der folgende Hinweis im Ergebnis "Hochrisikopflichten" wurde entfernt: "Ein zusätzlicher Ausschluss für Systeme, die "rein akzessorisch in Bezug auf die zu treffende Maßnahme oder Entscheidung" sind, wird spätestens ein Jahr nach Einführung des AI-Gesetzes definiert." Dieser Ausschluss ist in Artikel 7 des endgültigen Entwurfs nicht mehr enthalten.

11. März 2024

- Der Compliance Checker wurde aktualisiert, um den "endgültigen Entwurf" des AI-Gesetzes zu berücksichtigen.

Datenschutz: Wir sind verpflichtet, Ihre Eingaben aus diesem Formular, einschließlich Ihrer E-Mail-Adresse, zu speichern, um Ihnen Ihre Ergebnisse per E-Mail zuzusenden. Wenn Sie die E-Mail-Funktion nicht nutzen, werden keine Ihrer Daten gespeichert. Wir speichern keine anderen Daten, die dazu dienen könnten, Sie oder Ihr Gerät zu identifizieren. Wenn Sie anonym bleiben möchten, verwenden Sie bitte eine E-Mail-Adresse, die Ihre Identität nicht preisgibt. Wir geben keine Ihrer Daten an andere Parteien weiter. Wenn Sie möchten, dass Ihre Daten von unseren Servern gelöscht werden, wenden Sie sich bitte an taylor@futureoflife.org

Häufig gestellte Fragen

Wer hat dieses Instrument entwickelt und warum?

Dieses Tool wurde von dem Team des Future of Life Institute entwickelt. Wir sind in keiner Weise mit der Europäischen Union verbunden. Wir haben dieses Tool freiwillig entwickelt, um die wirksame Umsetzung des KI-Gesetzes zu unterstützen, weil wir glauben, dass das KI-Gesetz unsere Mission unterstützt, sicherzustellen, dass die KI-Technologie für das Leben nützlich bleibt und extreme Risiken im großen Maßstab vermeidet.

Kann ich dieses Tool in meine eigene Website integrieren?

Unser Tool ist so aufgebaut, dass es schwierig ist, die Implementierung auf anderen Websites zu unterstützen. Wir haben keine API zur Verfügung. Daher empfehlen wir Ihnen in fast allen Fällen, dieses Tool den Nutzern Ihrer Website zur Verfügung zu stellen, indem Sie auf diese Webseite verlinken – Sie können dieses Mockup-Bild gerne verwenden, um das Tool auf Ihrer Website zu präsentieren.

Wann tritt der EU AI Act in Kraft?

Welche Risikokategorien sind in der EU AI-Verordnung definiert?

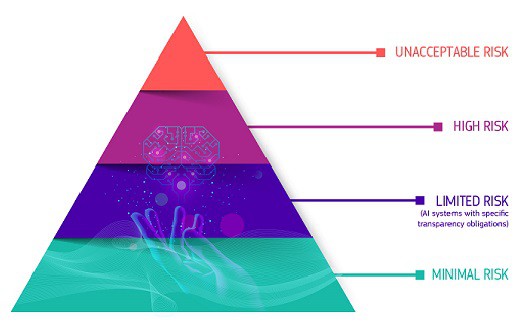

Der Rechtsrahmen des Gesetzes definiert vier Risikostufen für KI-Systeme: inakzeptabel, hoch, begrenzt und minimal oder kein Risiko. Systeme, die inakzeptable Risiken darstellen, wie die Bedrohung der Sicherheit, des Lebensunterhalts und der Rechte von Menschen - von sozialem Scoring durch Regierungen bis hin zu Spielzeug mit Sprachassistenz - werden verboten sein. Für Systeme mit hohem Risiko, wie z. B. solche, die in kritischen Infrastrukturen oder bei der Strafverfolgung eingesetzt werden, gelten strenge Anforderungen, u. a. in Bezug auf Risikobewertung, Datenqualität, Dokumentation, Transparenz, menschliche Aufsicht und Genauigkeit. Systeme mit begrenztem Risiko, wie Chatbots, müssen Transparenzanforderungen erfüllen, damit die Nutzer wissen, dass sie nicht mit Menschen interagieren. Systeme mit geringem Risiko, wie Spiele und Spamfilter, können frei verwendet werden.

Welcher Anteil der KI-Systeme wird in die Hochrisikokategorie fallen?

Es ist ungewiss, welcher Anteil der KI-Systeme in die Hochrisikokategorie fallen wird, da sich sowohl der Bereich der KI als auch das Recht noch in der Entwicklung befinden. Die Europäische Kommission schätzte in einer Folgenabschätzung, dass nur 5-15 % der Anwendungen strengeren Vorschriften unterliegen würden. Eine von appliedAI durchgeführte Studie über 106 KI-Systeme in Unternehmen ergab, dass 18 % ein hohes Risiko, 42 % ein geringes Risiko und 40 % ein unklares hohes oder geringes Risiko aufweisen. Die Systeme mit unklarer Risikoeinstufung waren in dieser Studie hauptsächlich in den Bereichen kritische Infrastrukturen, Beschäftigung, Strafverfolgung und Produktsicherheit zu finden. In einer damit zusammenhängenden Umfrage unter 113 KI-Start-ups in der EU glaubten 33 % der befragten Start-ups, dass ihre KI-Systeme als hochriskant eingestuft würden, während die Europäische Kommission nur 5-15 % der Systeme als hochriskant einschätzte.

Welche Sanktionen sieht das EU-KI-Gesetz vor?

Nach dem Standpunkt des Europäischen Parlaments können verbotene KI-Praktiken gemäß Artikel 5 mit Geldbußen von bis zu 40 Mio. EUR oder 7 % des weltweiten Jahresumsatzes geahndet werden - je nachdem, welcher Betrag höher ist. Die Nichteinhaltung der Anforderungen an die Datenverwaltung (gemäß Artikel 10) und der Anforderungen an die Transparenz und die Bereitstellung von Informationen (gemäß Artikel 13) kann zu Geldbußen von bis zu 20 Mio. EUR oder 4 % des weltweiten Umsatzes führen, je nachdem, welcher Betrag höher ist. Die Nichteinhaltung sonstiger Anforderungen oder Verpflichtungen kann mit Geldbußen von bis zu 10 Mio. EUR oder 2 % des weltweiten Umsatzes geahndet werden, je nachdem, welcher Betrag höher ist. Die Geldbußen sind je nach Verstoß gestaffelt, wobei für verbotene Praktiken die höchsten Strafen und für andere Verstöße niedrigere Höchststrafen vorgesehen sind.

Welche Maßnahmen sieht das EU-KI-Gesetz speziell für KMU vor?

Das EU-KI-Gesetz zielt darauf ab, KMU und Start-ups zu unterstützen, wie in Artikel 55 beschrieben. Zu den spezifischen Maßnahmen gehört die Gewährung eines vorrangigen Zugangs für KMU und Start-ups mit Sitz in der EU zu regulatorischen Sandkästen, wenn die Förderkriterien erfüllt sind. Darüber hinaus werden maßgeschneiderte Sensibilisierungsmaßnahmen und Aktivitäten zur Entwicklung digitaler Fähigkeiten organisiert, um den Bedürfnissen kleinerer Organisationen gerecht zu werden. Darüber hinaus werden spezielle Kommunikationskanäle eingerichtet, um Beratung anzubieten und Fragen von KMU und Start-ups zu beantworten. Die Beteiligung von KMU und anderen Interessengruppen an der Entwicklung von Normen wird ebenfalls gefördert. Um die finanzielle Belastung durch die Einhaltung der Vorschriften zu verringern, werden die Konformitätsbewertungsgebühren für KMU und Start-ups auf der Grundlage von Faktoren wie Entwicklungsstadium, Größe und Marktnachfrage gesenkt. Die Kommission wird die Zertifizierungs- und Konformitätskosten für KMU/Neugründungen regelmäßig überprüfen (mit Beiträgen aus transparenten Konsultationen) und mit den Mitgliedstaaten zusammenarbeiten, um diese Kosten nach Möglichkeit zu senken.

Kann ich das EU-KI-Gesetz freiwillig einhalten, auch wenn mein System nicht in den Anwendungsbereich fällt?

Ja! Die Kommission, das Amt für künstliche Intelligenz und/oder die Mitgliedstaaten werden freiwillige Verhaltenskodizes für die Anforderungen gemäß Titel III Kapitel 2 (z. B. Risikomanagement, Datenverwaltung und menschliche Aufsicht) für KI-Systeme fördern, die nicht als hochriskant eingestuft werden. Diese Verhaltenskodizes werden technische Lösungen dafür bieten, wie ein KI-System die Anforderungen erfüllen kann, je nach dem beabsichtigten Zweck des Systems. Auch andere Ziele wie ökologische Nachhaltigkeit, Zugänglichkeit, Beteiligung der Interessengruppen und Vielfalt der Entwicklungsteams werden berücksichtigt. Kleine Unternehmen und Start-ups werden bei der Förderung von Verhaltenskodizes berücksichtigt. Siehe Artikel 69 über Verhaltenskodizes für die freiwillige Anwendung spezifischer Anforderungen.