Consultez le texte intégral de la loi sur l'IA en ligne à l'aide de notreexplorateur de la loi sur l'IA ( ).

Vérification de la conformité à la loi européenne sur l'IA

La loi européenne sur l'IA introduit de nouvelles obligations pour les entités situées dans l'UE et ailleurs. Utilisez notre outil interactif pour déterminer si votre système d'IA sera soumis à ces obligations.

Si vous souhaitez vous tenir au courant de vos obligations au titre de la loi européenne sur l'IA, nous vous recommandons de vous abonner à la lettre d'information sur la loi européenne sur l'IA.

Pour plus de clarté, nous vous recommandons de demander l'avis d'un professionnel du droit et de suivre les directives nationales. De plus amples informations sur l'application de la loi européenne sur l'IA dans votre pays seront probablement fournies en 2024.

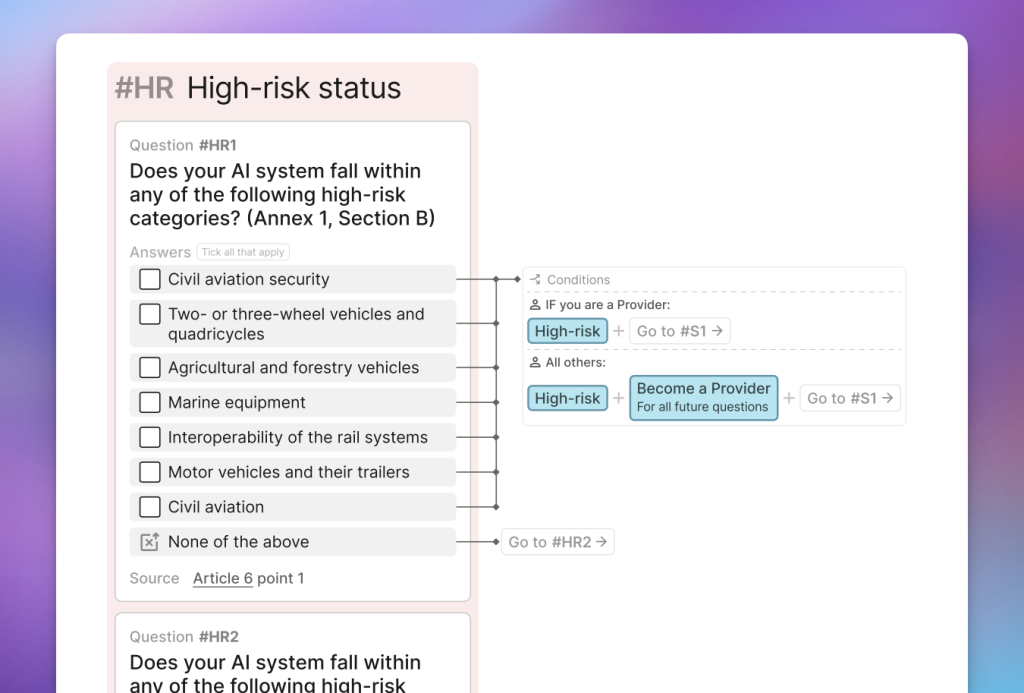

Visualiser le vérificateur de conformité sous forme d'organigramme PDF NOUVEAU

Voir un aperçu visuel de la logique complète du formulaire et l'enregistrer pour un accès hors ligne.

Commentaires - Nous travaillons à l'amélioration de cet outil. Veuillez envoyer vos commentaires à Taylor Jones à l'adresse suivante : taylor@futureoflife.org

Consultez le texte officiel ou parcourez-le en ligne à l'aide de notre AI Act Explorer. Le texte utilisé dans cet outil est la "Loi sur l'intelligence artificielle (Règlement (UE) 2024/1689), version du Journal officiel du 13 juin 2024". Dossier interinstitutionnel : 2021/0106(COD)

Changelog

3 juillet 2025

- Les obligations des distributeurs et des importateurs ne sont désormais affichées que si le système d'IA de l'utilisateur est à haut risque.

- Fournit une description complète des obligations des fournisseurs de systèmes d'IA à haut risque.

- Mise à jour de la description des obligations des déployeurs afin de mieux refléter le texte juridique.

25 avril 2025

- Ajout d'une question et d'obligations pour les "Fournisseurs de modèles d'IA à usage général avec risque systémique".

16 avril 2025

- Auparavant, les représentants autorisés étaient traités comme des prestataires. Désormais, ils disposent d'une logique de formulaire distincte et ne reçoivent que les obligations des représentants autorisés.

- Les fabricants de produits reçoivent désormais des questions relatives au champ d'application avant d'évaluer si leur système présente un risque élevé.

- Ajout d'obligations spécifiques pour les fabricants de produits.

- Ajout d'une note pour informer les utilisateurs qu'ils peuvent être considérés comme des "opérateurs" au sens de l'article 3 et qu'ils ont donc des obligations correspondantes.

- Clarification de la formulation relative aux obligations de transparence.

- Clarification de la formulation concernant le champ d'application pour les importateurs.

- Suppression d'une option de portée redondante.

- Fusion de la question "Modèles d'IA à usage général" avec la question "Champ d'application" afin de simplifier le formulaire pour les fournisseurs.

15 avril 2025

- Ajout d'obligations de "maîtrise de l'IA" pour les fournisseurs et les déployeurs.

- Ajout d'une question sur l'évaluation de l'impact sur les droits fondamentaux et d'obligations pour les utilisateurs de systèmes d'intelligence artificielle à haut risque.

- Modification de la formulation concernant les "modèles d'IA à usage général" afin d'éviter toute confusion entre les "modèles" et les "systèmes".

- Clarification de la formulation relative aux systèmes d'IA interdits, notamment en ce qui concerne les systèmes de reconnaissance des émotions.

- Clarification de la formulation des exemptions pour les "activités personnelles et non professionnelles" et pour les "autorités publiques ou organisations internationales dans les pays tiers".

1er avril 2025

- Nous avons procédé à une refonte importante de l'ordre des formulaires afin d'éviter les bogues qui se produisent dans certains cas particuliers. En particulier, les questions relatives au "risque élevé" ont été déplacées beaucoup plus tôt dans le formulaire, de sorte qu'il est possible de déterminer beaucoup plus tôt si certaines entités "deviennent un prestataire" au sens des articles 22 et 25.

26 mars 2024

- Correction d'un bug qui empêchait les déployeurs de recevoir leurs obligations au titre de l'article 29.

- Suppression de l'avis suivant dans le résultat "Obligations à haut risque" : "Une exclusion supplémentaire pour les systèmes qui sont "purement accessoires par rapport à l'action ou à la décision pertinente à prendre" sera définie au plus tard un an après l'introduction de la loi sur l'IA. Cette exclusion ne figure plus à l'article 7 du projet final.

11 mars 2024

- Mise à jour du vérificateur de conformité pour refléter la "version finale" de la loi sur l'IA.

Confidentialité des données : Afin de pouvoir vous envoyer vos résultats par courrier électronique, nous sommes tenus de conserver les données que vous avez saisies dans ce formulaire, y compris votre adresse électronique. Si vous n'utilisez pas la fonction d'envoi par courrier électronique, aucune de vos données ne sera stockée. Nous ne stockons aucune autre donnée susceptible d'être utilisée pour vous identifier ou identifier votre appareil. Si vous souhaitez rester anonyme, veuillez utiliser une adresse électronique qui ne révèle pas votre identité. Nous ne partageons aucune de vos données avec d'autres parties. Si vous souhaitez que vos données soient supprimées de nos serveurs, veuillez contacter taylor@futureoflife.org.

Remerciements :

La logique de ce formulaire a été testée par Tomas Bueno Momcilovic, chercheur scientifique à Fortiss. La traduction japonaise a été fournie par Citadel AI.

Questions fréquemment posées

Qui a développé cet outil et pourquoi ?

Cet outil a été développé par l'équipe du Future of Life Institute. Nous ne sommes en aucun cas affiliés à l'Union européenne. Nous avons développé cet outil volontairement afin de contribuer à la mise en œuvre efficace de la loi sur l'IA, car nous pensons que la loi sur l'IA soutient notre mission visant à garantir que la technologie de l'IA reste bénéfique pour la vie et qu'elle évite les risques extrêmes à grande échelle.

Puis-je intégrer cet outil dans mon propre site web ?

Notre outil est construit d'une manière qui rend difficile sa mise en œuvre sur d'autres sites. Nous n'avons pas d'API disponible. Par conséquent, dans la plupart des cas, nous vous suggérons de mettre cet outil à la disposition des déployeurs de votre site web par l'un ou l'autre des moyens suivants :

A) Lien vers cette page web - vous pouvez utiliser ces images pour présenter l'outil sur votre site.

B) Intégrer la version pleine page de cet outil dans votre site sous la forme d'un iframe. Veuillez noter que les iframes peuvent être difficiles à utiliser sur les appareils mobiles et qu'ils ajouteront de nouveaux cookies et scripts sur les appareils de vos déployeurs. Cette méthode n'est donc pas recommandée.

Quand la loi européenne sur l'IA entre-t-elle en vigueur ?

La loi sur l'IA de l'UE est entrée en vigueur le 1er août 2024. Il s'ensuit maintenant une période de mise en œuvre de deux à trois ans, les différentes parties de la loi entrant en vigueur à des dates différentes. Notre calendrier de mise en œuvre donne un aperçu de toutes les dates clés relatives à la mise en œuvre de la loi.

Au cours de la période de mise en œuvre, les organismes européens de normalisation devraient élaborer des normes pour la loi sur l'IA.

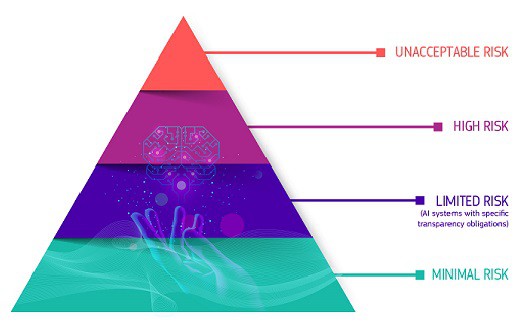

Quelles sont les catégories de risques définies par la loi européenne sur l'IA ?

Le cadre réglementaire de la loi définit quatre niveaux de risque pour les systèmes d'IA : inacceptable, élevé, limité et minimal ou nul. Les systèmes présentant des risques inacceptables, tels que la menace pour la sécurité, les moyens de subsistance et les droits des personnes - de la notation sociale par les gouvernements aux jouets utilisant l'assistance vocale - seront interdits. Les systèmes à haut risque, tels que ceux utilisés dans les infrastructures critiques ou par les forces de l'ordre, seront soumis à des exigences strictes, notamment en matière d'évaluation des risques, de qualité des données, de documentation, de transparence, de surveillance humaine et d'exactitude. Les systèmes présentant des risques limités, comme les robots de conversation, doivent respecter des obligations de transparence afin que les déployeurs sachent qu'ils n'interagissent pas avec des humains. Les systèmes à risque minimal, tels que les jeux et les filtres anti-spam, peuvent être utilisés librement.

Quelle est la part des systèmes d'IA qui entreront dans la catégorie des systèmes à haut risque ?

Il est difficile de savoir quelle proportion de systèmes d'IA entrera dans la catégorie à haut risque, car le domaine de l'IA et la législation sont encore en pleine évolution. La Commission européenne a estimé dans une étude d'impact que seulement 5 à 15 % des applications seraient soumises à des règles plus strictes. Une étude d'appliedAI portant sur 106 systèmes d'IA d'entreprise a révélé que 18 % d'entre eux présentaient un risque élevé, 42 % un risque faible et 40 % ne savaient pas s'il s'agissait d'un risque élevé ou faible. Les systèmes dont la classification des risques n'était pas claire dans cette étude relevaient principalement des domaines des infrastructures critiques, de l'emploi, de l'application de la loi et de la sécurité des produits. Dans une enquête connexe menée auprès de 113 startups européennes spécialisées dans l'IA, 33 % des startups interrogées pensaient que leurs systèmes d'IA seraient classés comme présentant un risque élevé, contre 5 à 15 % selon l'évaluation de la Commission européenne.

Quelles sont les sanctions prévues par la loi européenne sur l'IA ?

Selon la position adoptée par le Parlement européen, le recours aux pratiques interdites en matière d'intelligence artificielle visées à l'article 5 peut entraîner des amendes allant jusqu'à 40 millions d'euros ou 7 % du chiffre d'affaires annuel mondial, le montant le plus élevé étant retenu. Le non-respect des exigences en matière de gouvernance des données (article 10) et des exigences en matière de transparence et de fourniture d'informations (article 13) peut entraîner des amendes allant jusqu'à 20 millions d'euros ou 4 % du chiffre d'affaires mondial, le montant le plus élevé étant retenu. Le non-respect de toute autre exigence ou obligation peut entraîner des amendes allant jusqu'à 10 millions d'euros ou 2 % du chiffre d'affaires mondial - là encore, le montant le plus élevé est retenu. Les amendes sont échelonnées en fonction de la disposition enfreinte, les pratiques interdites étant sanctionnées par les amendes les plus élevées et les autres violations par des amendes maximales moins élevées.

Quelles mesures la loi européenne sur l'IA met-elle en œuvre pour les PME en particulier ?

La loi européenne sur l'IA vise à soutenir les PME et les startups, comme le précise l'article 55. Les mesures spécifiques comprennent l'octroi d'un accès prioritaire aux bacs à sable réglementaires pour les PME et les startups basées dans l'UE si les critères d'éligibilité sont remplis. En outre, des activités de sensibilisation et de développement des compétences numériques seront organisées pour répondre aux besoins des petites organisations. En outre, des canaux de communication dédiés seront mis en place pour offrir des conseils et répondre aux questions des PME et des startups. La participation des PME et des autres parties prenantes au processus d'élaboration des normes sera également encouragée. Afin de réduire la charge financière liée à la conformité, les frais d'évaluation de la conformité seront réduits pour les PME et les startups en fonction de facteurs tels que le stade de développement, la taille et la demande du marché. La Commission examinera régulièrement les coûts de certification et de mise en conformité pour les PME et les jeunes entreprises (en s'appuyant sur des consultations transparentes) et collaborera avec les États membres pour réduire ces coûts dans la mesure du possible.

Puis-je me conformer volontairement à la loi européenne sur l'IA même si mon système n'entre pas dans son champ d'application ?

Oui ! La Commission, l'AI Office et/ou les États membres encourageront les codes de conduite volontaires pour les exigences du titre III, chapitre 2 (par exemple, la gestion des risques, la gouvernance des données et la surveillance humaine) pour les systèmes d'IA qui ne sont pas considérés comme présentant un risque élevé. Ces codes de conduite fourniront des solutions techniques sur la manière dont un système d'IA peut satisfaire aux exigences, en fonction de l'objectif visé par le système. D'autres objectifs tels que la durabilité environnementale, l'accessibilité, la participation des parties prenantes et la diversité des équipes de développement seront pris en compte. Les petites entreprises et les jeunes pousses seront prises en compte lors de l'élaboration des codes de conduite. Voir l'article 69 sur les codes de conduite pour l'application volontaire d'exigences spécifiques.

Faites-nous savoir quelles sont les ressources dont vous avez besoin

Nous sommes à la recherche de commentaires en deux minutes sur le site web de la loi sur l'IA, afin que nous puissions créer les ressources qui vous seront les plus utiles. Nous avons produit de nombreuses ressources sur notre site web en réponse directe aux commentaires des utilisateurs, parfois en l'espace d'une à deux semaines seulement.

Ce site existe dans le but de fournir des informations utiles et objectives sur les développements liés à la loi européenne sur l'IA. Il est utilisé par plus de 150 000 utilisateurs chaque mois. Nous vous remercions d'avance pour le temps et les efforts que vous consacrez à ce site. Nous espérons pouvoir vous rendre la pareille en vous fournissant des informations adaptées et de grande qualité qui répondent à vos besoins.