Consulte el texto íntegro de la Ley de IA en línea a través de nuestroExplorador de la Ley de IA

Verificador del cumplimiento de la Ley de IA de la UE

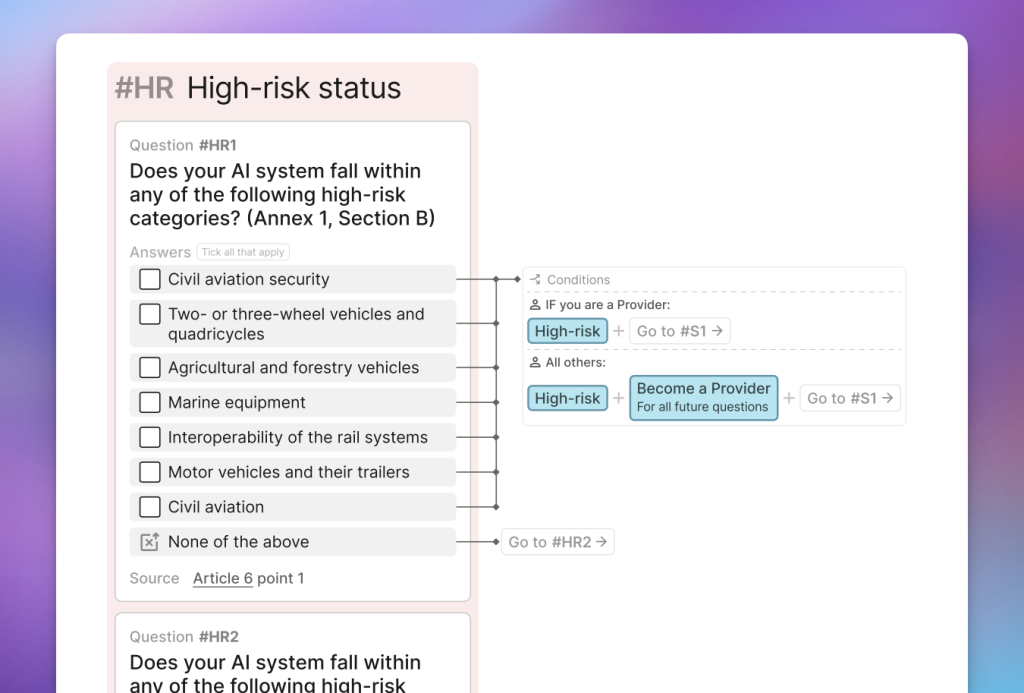

La Ley de AI de la UE introduce nuevas obligaciones para las entidades situadas dentro y fuera de la UE. Utilice nuestra herramienta interactiva para determinar si su sistema de IA estará sujeto a ellas.

Si desea mantenerse al día sobre sus obligaciones en virtud de la Ley de la UE sobre la IA, le recomendamos que se suscriba al Boletín de la Ley de la UE sobre la IA.

Para mayor claridad, le recomendamos que busque asesoramiento jurídico profesional y siga las orientaciones nacionales. Es probable que en 2024 se facilite más información sobre la aplicación de la Ley de IA de la UE en su país.

Ver el verificador de la conformidad como diagrama de flujo en PDF NUEVO

Vea un resumen visual de toda la lógica del formulario y guárdelo para acceder a él sin conexión.

Comentarios - Estamos trabajando para mejorar esta herramienta. Por favor, envíe sus comentarios a Taylor Jones en taylor@futureoflife.org

Consulte el texto oficial o navegue por él en línea con nuestro Explorador de la Ley de IA. El texto utilizado en esta herramienta es la "Ley de Inteligencia Artificial (Reglamento (UE) 2024/1689), versión del Diario Oficial de 13 de junio de 2024". Expediente interinstitucional: 2021/0106(COD)

Registro de cambios

3 de julio de 2025

- Las obligaciones del Distribuidor y del Importador ahora sólo se muestran si el sistema de IA del usuario es de alto riesgo.

- Proporcionó una descripción completa de las obligaciones de los proveedores de sistemas de IA de alto riesgo.

- Se ha actualizado la descripción de las obligaciones de los Desplegadores para reflejar con mayor exactitud el texto legal.

25 de abril de 2025

- Se ha añadido una pregunta y obligaciones para los "Proveedores de modelos de IA de propósito general con riesgo sistémico".

16 de abril de 2025

- Anteriormente, los representantes autorizados eran tratados como proveedores. Ahora tienen una lógica de formulario distinta, y sólo reciben obligaciones de Representante Autorizado.

- Los fabricantes de productos reciben ahora preguntas relacionadas con el ámbito de aplicación antes de evaluar si su sistema es de alto riesgo.

- Se han añadido obligaciones específicas para los fabricantes de productos.

- Se ha añadido una nota para informar a los usuarios de que pueden ser considerados "operadores" con arreglo al artículo 3 y, por tanto, tienen las obligaciones correspondientes.

- Se ha aclarado el lenguaje relativo a las obligaciones de transparencia.

- Aclaración del ámbito de aplicación para los importadores.

- Se ha eliminado una opción de ámbito redundante.

- Fusión de la pregunta "Modelos de IA de uso general" en la pregunta "Ámbito de aplicación" para simplificar el formulario a los proveedores.

15 de abril de 2025

- Se han añadido obligaciones de "alfabetización en IA" para proveedores e implantadores.

- Se añaden la pregunta "Evaluación del impacto sobre los derechos fundamentales" y las obligaciones para quienes desplieguen sistemas de IA de alto riesgo.

- Modificación del lenguaje en torno a los "modelos de IA de propósito general" para evitar confusiones entre "modelos" y "sistemas".

- Aclaración del lenguaje en torno a los sistemas de IA prohibidos, en particular en torno a los sistemas de reconocimiento de emociones.

- Se ha aclarado la redacción en torno a las exenciones para "actividades personales no profesionales" y para "autoridades públicas u organizaciones internacionales de terceros países".

1 de abril de 2025

- Se ha llevado a cabo una refactorización significativa de la ordenación del formulario para evitar que se produzcan errores en algunos casos extremos. En particular, se han desplazado las preguntas de "alto riesgo" mucho antes en el formulario, de modo que pueda determinarse mucho antes si determinadas entidades "se convierten en proveedores" de conformidad con los artículos 22 y 25.

26 de marzo de 2024

- Se ha corregido un error que impedía a los Desplegadores recibir sus obligaciones en virtud del artículo 29.

- Eliminado el siguiente aviso en el resultado "Obligaciones de alto riesgo": "Sedefinirá una exclusión adicional para los sistemas que sean "puramente accesorios con respecto a la acción o decisión pertinente que deba tomarse" a más tardar un año después de la introducción de la Ley AI." Esta exclusión ya no está presente en el artículo 7 del proyecto final.

11 de marzo de 2024

- Se ha actualizado el verificador de la conformidad para reflejar el "proyecto final" de la Ley de IA.

Protección de datos: Para poder enviarle los resultados por correo electrónico, debemos almacenar los datos introducidos en este formulario, incluida su dirección de correo electrónico. Si no utiliza la función de correo electrónico, no se almacenará ninguno de sus datos. No almacenamos ningún otro dato que pueda utilizarse para identificarle a usted o a su dispositivo. Si desea permanecer en el anonimato, utilice una dirección de correo electrónico que no revele su identidad. No compartimos ninguno de sus datos con terceros. Si desea que sus datos sean eliminados de nuestros servidores, póngase en contacto con taylor@futureoflife.org.

Agradecimientos:

La lógica de este formulario fue sometida a pruebas de estrés por Tomas Bueno Momcilovic, investigador científico de Fortiss. La traducción al japonés corrió a cargo de Citadel AI.

Preguntas frecuentes

¿Quién desarrolló esta herramienta y por qué?

Esta herramienta es desarrollada por el equipo del Future of Life Institute. No estamos afiliados de ninguna manera a la Unión Europea. Hemos desarrollado esta herramienta de forma voluntaria para ayudar a la aplicación efectiva de la Ley de IA, porque creemos que la Ley de IA respalda nuestra misión de garantizar que la tecnología de IA siga siendo beneficiosa para la vida y evite riesgos extremos a gran escala.

¿Puedo integrar esta herramienta en mi propio sitio web?

Nuestra herramienta está construida de una manera que dificulta su implementación en otros sitios. No disponemos de una API. Por lo tanto, para casi todos los casos, le sugerimos que ponga esta herramienta a disposición de los usuarios de su sitio web ya sea:

A) Enlace a esta página web: le invitamos a utilizar estas imágenes maqueta para presentar la herramienta en su sitio web.

B) Incrustar la versión de página completa de esta herramienta en su sitio web como iframe. Tenga en cuenta que los iframes pueden ser difíciles de usar en dispositivos móviles, y añadirán nuevas cookies y scripts a los dispositivos de sus usuarios. Por lo tanto, no se recomienda este método.

¿Cuándo entra en vigor la Ley europea de IA?

La Ley de AI de la UE entró en vigor el 1 de agosto de 2024. Ahora sigue un periodo de aplicación de dos a tres años, ya que varias partes de la Ley entran en vigor en fechas diferentes. Nuestro calendario de aplicación ofrece una visión general de todas las fechas clave relacionadas con la aplicación de la Ley.

Durante el periodo de aplicación, se espera que los organismos europeos de normalización elaboren normas para la Ley de IA.

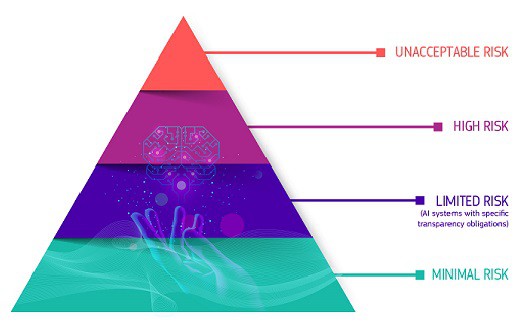

¿Cuáles son las categorías de riesgo definidas por la Ley de AI de la UE?

El marco regulador de la Ley define cuatro niveles de riesgo para los sistemas de IA: inaceptable, alto, limitado y mínimo o nulo. Estarán prohibidos los sistemas que planteen riesgos inaceptables, como amenazar la seguridad, los medios de vida y los derechos de las personas, desde el escrutinio social por parte de los gobiernos hasta los juguetes que utilizan asistencia por voz. Los sistemas de alto riesgo, como los utilizados en infraestructuras críticas o para hacer cumplir la ley, deberán cumplir requisitos estrictos en materia de evaluación de riesgos, calidad de los datos, documentación, transparencia, supervisión humana y precisión. Los sistemas que plantean riesgos limitados, como los chatbots, deben cumplir obligaciones de transparencia para que los usuarios sepan que no están interactuando con seres humanos. Los sistemas de riesgo mínimo, como los juegos y los filtros de spam, pueden utilizarse libremente.

¿Qué proporción de sistemas de IA entrará en la categoría de alto riesgo?

No se sabe con certeza qué proporción de los sistemas de IA entrarán en la categoría de alto riesgo, ya que tanto el campo de la IA como la legislación aún están evolucionando. La Comisión Europea estimó en un estudio de impacto que solo entre el 5 % y el 15 % de las aplicaciones estarían sujetas a normas más estrictas. Un estudio realizado por appliedAI sobre 106 sistemas de IA empresarial concluyó que el 18% eran de alto riesgo, el 42% de bajo riesgo y el 40% no tenía claro si era de alto o bajo riesgo. Los sistemas con clasificación de riesgo poco clara en este estudio se encontraban principalmente en las áreas de infraestructuras críticas, empleo, aplicación de la ley y seguridad de los productos. En una encuesta relacionada de 113 empresas emergentes de IA de la UE, el 33% de las empresas emergentes encuestadas creían que sus sistemas de IA se clasificarían como de alto riesgo, en comparación con el 5-15% evaluado por la Comisión Europea.

¿Cuáles son las sanciones de la Ley de AI de la UE?

Sobre la base de la posición adoptada por el Parlamento Europeo, el uso de las prácticas prohibidas de IA indicadas en el artículo 5 puede dar lugar a multas de hasta 40 millones de euros, o el 7% del volumen de negocios anual mundial, si este último es superior. El incumplimiento de los requisitos de gobernanza de datos (en virtud del artículo 10) y de los requisitos de transparencia y suministro de información (en virtud del artículo 13) puede dar lugar a multas de hasta 20 millones de euros, o el 4% del volumen de negocios mundial, si este último es superior. El incumplimiento de cualquier otro requisito u obligación puede dar lugar a multas de hasta 10 millones de euros o el 2% del volumen de negocios mundial, si este último es superior. Las multas se escalonan en función de la disposición infringida: las prácticas prohibidas reciben las sanciones más elevadas y las demás infracciones multas máximas más bajas.

¿Qué medidas aplica la Ley de la UE sobre la IA específicamente para las PYME?

La Ley de Inteligencia Artificial de la UE tiene como objetivo apoyar a las PYME y a las nuevas empresas, tal y como se especifica en el artículo 55. Entre las medidas específicas se incluye la concesión de acceso prioritario a los espacios aislados de regulación a las PYME y a las nuevas empresas con sede en la UE que cumplan los criterios de elegibilidad. Además, se organizarán actividades de sensibilización y desarrollo de competencias digitales adaptadas a las necesidades de las organizaciones más pequeñas. Además, se crearán canales de comunicación específicos para ofrecer orientación y responder a las preguntas de las PYME y las nuevas empresas. También se fomentará la participación de las PYME y otras partes interesadas en el proceso de elaboración de normas. Para reducir la carga financiera que supone el cumplimiento de las normas, se reducirán las tasas de evaluación de la conformidad para las PYME y las empresas de nueva creación en función de factores como la fase de desarrollo, el tamaño y la demanda del mercado. La Comisión revisará periódicamente los costes de certificación y cumplimiento para las PYME y las nuevas empresas (con aportaciones de consultas transparentes) y trabajará con los Estados miembros para reducir estos costes cuando sea posible.

¿Puedo cumplir voluntariamente la Ley de IA de la UE aunque mi sistema no esté incluido en su ámbito de aplicación?

Sí. La Comisión, la Oficina de Inteligencia Artificial y/o los Estados miembros fomentarán códigos de conducta voluntarios para los requisitos del título III, capítulo 2 (por ejemplo, gestión de riesgos, gobernanza de datos y supervisión humana) para los sistemas de inteligencia artificial que no se consideren de alto riesgo. Estos códigos de conducta proporcionarán soluciones técnicas sobre cómo un sistema de IA puede cumplir los requisitos, de acuerdo con la finalidad prevista del sistema. Se tendrán en cuenta otros objetivos como la sostenibilidad medioambiental, la accesibilidad, la participación de las partes interesadas y la diversidad de los equipos de desarrollo. Las pequeñas empresas y las startups se tendrán en cuenta a la hora de fomentar los códigos de conducta. Véase el artículo 69 sobre códigos de conducta para la aplicación voluntaria de requisitos específicos.

Díganos qué recursos necesita

Buscamos comentarios de 2 minutos sobre el sitio web de la Ley de IA, para que podamos crear los recursos más útiles para usted. Hemos creado muchos de los recursos de nuestro sitio web en respuesta directa a los comentarios de los usuarios, a veces en tan solo 1-2 semanas.

Este sitio existe con el objetivo de proporcionar información útil y objetiva sobre los avances relacionados con la Ley de AI de la UE. Más de 150 000 usuarios la utilizan cada mes. Gracias de antemano por su tiempo y esfuerzo; esperamos poder devolvérselo con información adaptada y de alta calidad que responda a sus necesidades.