Przeglądaj pełny tekst ustawy o sztucznej inteligencji online, korzystając z naszejwyszukiwarki AIAct Explorer.

Narzędzie do sprawdzania zgodności z unijną ustawą o sztucznej inteligencji

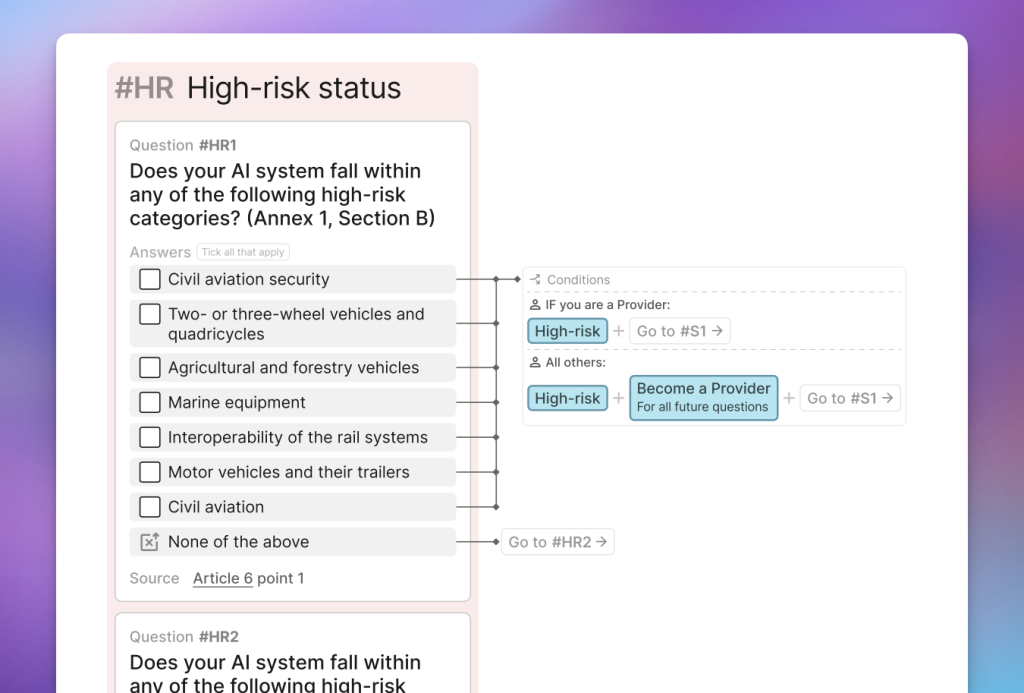

Unijna ustawa o sztucznej inteligencji wprowadza nowe obowiązki dla podmiotów zlokalizowanych w UE i poza nią. Skorzystaj z naszego interaktywnego narzędzia, aby ustalić, czy Twój system sztucznej inteligencji będzie podlegał tym obowiązkom.

Jeśli chcesz być na bieżąco z obowiązkami wynikającymi z unijnej ustawy o sztucznej inteligencji, zalecamy subskrypcję biuletynu EU AI Act.

W celu uzyskania większej jasności zalecamy zasięgnięcie profesjonalnej porady prawnej i postępowanie zgodnie z krajowymi wytycznymi. Więcej informacji na temat egzekwowania unijnej ustawy o sztucznej inteligencji w Twoim kraju zostanie prawdopodobnie przekazanych w 2024 r.

Wyświetlanie narzędzia do sprawdzania zgodności w formie schematu blokowego PDF NOWOŚĆ

Zobacz wizualny przegląd pełnej logiki formularza i zapisz go w celu uzyskania dostępu offline.

Opinie - Pracujemy nad ulepszeniem tego narzędzia. Prosimy o przesyłanie opinii do Taylor Jones na adres taylor@futureoflife.org

Zobacz oficjalny tekst lub przeglądaj go online za pomocą naszej wyszukiwarki AI Act Explorer. Tekst użyty w tym narzędziu to "Ustawa o sztucznej inteligencji (rozporządzenie (UE) 2024/1689), wersja z Dziennika Urzędowego z dnia 13 czerwca 2024 r.". Plik międzyinstytucjonalny: 2021/0106(COD)

Dziennik zmian

3 lipca 2025 r.

- Zobowiązania dystrybutora i importera są teraz wyświetlane tylko wtedy, gdy system AI użytkownika jest wysokiego ryzyka.

- Zapewniono pełny opis obowiązków dostawców systemów AI wysokiego ryzyka.

- Zaktualizowano opis obowiązków podmiotów wdrażających, aby dokładniej odzwierciedlał tekst prawny.

25 kwietnia 2025 r.

- Dodano pytanie i obowiązki dla "Dostawców modeli sztucznej inteligencji ogólnego przeznaczenia z ryzykiem systemowym".

16 kwietnia 2025 r.

- Wcześniej autoryzowani przedstawiciele byli traktowani jako dostawcy. Teraz mają odrębną logikę formularzy i otrzymują tylko obowiązki autoryzowanego przedstawiciela.

- Producenci produktów otrzymują teraz pytania dotyczące zakresu przed oceną, czy ich system jest obarczony wysokim ryzykiem.

- Dodano szczegółowe obowiązki dla producentów produktów.

- Dodano uwagę informującą użytkowników, że mogą być uważani za "operatora" zgodnie z art. 3, a zatem mają odpowiednie obowiązki.

- Wyjaśniono język dotyczący obowiązków w zakresie przejrzystości.

- Wyjaśniono język dotyczący zakresu dla importerów.

- Usunięto zbędną opcję zakresu.

- Połączono pytanie "Modele AI ogólnego przeznaczenia" z pytaniem "Zakres", aby usprawnić formularz dla dostawców.

15 kwietnia 2025 r.

- Dodano obowiązki w zakresie "znajomości sztucznej inteligencji" dla dostawców i podmiotów wdrażających.

- Dodano pytanie "Ocena wpływu na prawa podstawowe" i obowiązki dla podmiotów wdrażających systemy sztucznej inteligencji wysokiego ryzyka.

- Zmodyfikowano język wokół "modeli AI ogólnego przeznaczenia", aby upewnić się, że nie ma pomyłki między "modelami" a "systemami".

- Wyjaśniono język dotyczący zakazanych systemów sztucznej inteligencji, w szczególności systemów rozpoznawania emocji.

- Wyjaśniono język dotyczący wyłączeń dla "osobistej, nieprofesjonalnej działalności" oraz dla "organów publicznych lub organizacji międzynarodowych w państwach trzecich".

1 kwietnia 2025 r.

- Przeprowadzono znaczącą refaktoryzację zamawiania formularzy, aby zapobiec występowaniu błędów w niektórych przypadkach brzegowych. W szczególności przeniesiono pytania dotyczące "wysokiego ryzyka" znacznie wcześniej w formularzu, aby można było znacznie wcześniej ustalić, czy niektóre podmioty "stają się dostawcą" zgodnie z art. 22 i 25.

26 marca 2024 r.

- Naprawiono błąd, który uniemożliwiał podmiotom wdrażającym otrzymywanie obowiązków wynikających z art. 29.

- Usunięto następujące powiadomienie w wyniku "Obowiązki wysokiego ryzyka": "Dodatkowe wyłączenie dla systemów, które są "czysto pomocnicze w odniesieniu do odpowiedniego działania lub decyzji, która ma zostać podjęta", zostanie zdefiniowane nie później niż rok po wprowadzeniu ustawy o sztucznej inteligencji.". Wyłączenie to nie jest już obecne w art. 7 ostatecznej wersji projektu.

11 marca 2024 r.

- Zaktualizowano narzędzie do sprawdzania zgodności, aby odzwierciedlało "ostateczny projekt" ustawy o sztucznej inteligencji.

Prywatność danych: W celu przesłania wyników e-mailem jesteśmy zobowiązani do przechowywania danych wprowadzonych w tym formularzu, w tym adresu e-mail. Jeśli użytkownik nie skorzysta z funkcji wysyłania wiadomości e-mail, żadne jego dane nie będą przechowywane. Nie przechowujemy żadnych innych danych, które mogłyby posłużyć do identyfikacji użytkownika lub jego urządzenia. Jeśli chcesz pozostać anonimowy, użyj adresu e-mail, który nie ujawnia Twojej tożsamości. Nie udostępniamy żadnych danych użytkownika innym podmiotom. Jeśli chcesz, aby Twoje dane zostały usunięte z naszych serwerów, skontaktuj się z nami pod adresem taylor@futureoflife.org.

Podziękowania:

Logika tego formularza została przetestowana przez Tomasa Bueno Momcilovica, pracownika naukowego Fortiss. Tłumaczenie na język japoński zostało dostarczone przez Citadel AI.

Często zadawane pytania

Kto opracował to narzędzie i dlaczego?

To narzędzie zostało opracowane przez zespół Future of Life Institute. Nie jesteśmy w żaden sposób powiązani z Unią Europejską. Opracowaliśmy to narzędzie dobrowolnie, aby pomóc w skutecznym wdrożeniu ustawy o sztucznej inteligencji, ponieważ uważamy, że ustawa o sztucznej inteligencji wspiera naszą misję zapewnienia, że technologia sztucznej inteligencji pozostanie korzystna dla życia i pozwoli uniknąć ekstremalnych zagrożeń na dużą skalę.

Czy mogę zintegrować to narzędzie z moją własną stroną internetową?

Nasze narzędzie jest zbudowane w sposób, który utrudnia jego implementację na innych stronach. Nie mamy dostępnego interfejsu API. Dlatego w prawie wszystkich przypadkach sugerujemy, aby udostępnić to narzędzie użytkownikom swojej witryny internetowej:

A) Linkowanie do tej strony - zachęcamy do korzystania z tych makiet w celu umieszczenia narzędzia na swojej stronie.

B) Osadzenie pełnostronicowej wersji tego narzędzia w witrynie jako ramki iframe. Należy pamiętać, że ramki iframe mogą być trudne w użyciu na urządzeniach mobilnych i będą dodawać nowe pliki cookie i skrypty do urządzeń użytkowników. Dlatego ta metoda nie jest zalecana.

Kiedy wejdzie w życie unijna ustawa o sztucznej inteligencji?

Unijna ustawa o sztucznej inteligencji weszła w życie 1 sierpnia 2024 roku. Teraz następuje okres wdrażania trwający od dwóch do trzech lat, ponieważ różne części ustawy wchodzą w życie w różnych terminach. Nasz harmonogram wdrażania zawiera przegląd wszystkich kluczowych dat związanych z wdrożeniem ustawy.

W okresie wdrażania oczekuje się, że europejskie organy normalizacyjne opracują normy dla AI Act.

Jakie są kategorie ryzyka zdefiniowane w unijnej ustawie o sztucznej inteligencji?

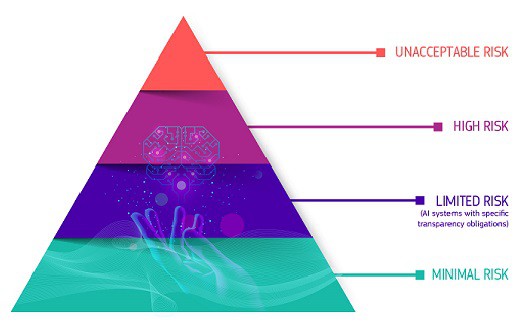

Ramy regulacyjne ustawy definiują cztery poziomy ryzyka dla systemów sztucznej inteligencji: niedopuszczalne, wysokie, ograniczone oraz minimalne lub zerowe. Systemy stwarzające niedopuszczalne ryzyko, takie jak zagrażanie bezpieczeństwu ludzi, ich egzystencji i prawom - od oceny społecznej przez rządy po zabawki korzystające z pomocy głosowej - będą zabronione. Systemy wysokiego ryzyka, takie jak te wykorzystywane w infrastrukturze krytycznej lub egzekwowaniu prawa, będą musiały spełniać surowe wymagania, w tym dotyczące oceny ryzyka, jakości danych, dokumentacji, przejrzystości, nadzoru ludzkiego i dokładności. Systemy stwarzające ograniczone ryzyko, takie jak chatboty, muszą przestrzegać obowiązków w zakresie przejrzystości, aby użytkownicy wiedzieli, że nie wchodzą w interakcję z ludźmi. Systemy o minimalnym ryzyku, takie jak gry i filtry antyspamowe, mogą być swobodnie używane.

Jaka część systemów AI będzie należeć do kategorii wysokiego ryzyka?

Nie jest pewne, jaka część systemów AI będzie należeć do kategorii wysokiego ryzyka, ponieważ zarówno dziedzina AI, jak i prawo wciąż ewoluują. Komisja Europejska oszacowała w badaniu wpływu, że tylko 5-15% aplikacji będzie podlegać bardziej rygorystycznym przepisom. Badanie przeprowadzone przez appliedAI na 106 systemach sztucznej inteligencji w przedsiębiorstwach wykazało, że 18% z nich było obarczonych wysokim ryzykiem, 42% niskim ryzykiem, a 40% nie było jasne, czy jest to wysokie czy niskie ryzyko. Systemy z niejasną klasyfikacją ryzyka w tym badaniu dotyczyły głównie obszarów infrastruktury krytycznej, zatrudnienia, egzekwowania prawa i bezpieczeństwa produktów. W powiązanej ankiecie przeprowadzonej wśród 113 unijnych startupów zajmujących się sztuczną inteligencją, 33% ankietowanych startupów uważało, że ich systemy sztucznej inteligencji zostaną sklasyfikowane jako obarczone wysokim ryzykiem, w porównaniu z 5-15% ocenianymi przez Komisję Europejską.

Jakie są kary wynikające z unijnej ustawy o sztucznej inteligencji?

Zgodnie z przyjętym stanowiskiem Parlamentu Europejskiego, stosowanie zakazanych praktyk AI opisanych w art. 5 może skutkować karami w wysokości do 40 mln euro lub 7% rocznego światowego obrotu - w zależności od tego, która z tych kwot jest wyższa. Nieprzestrzeganie wymogów dotyczących zarządzania danymi (zgodnie z art. 10) oraz wymogów dotyczących przejrzystości i przekazywania informacji (zgodnie z art. 13) może prowadzić do nałożenia grzywny w wysokości do 20 mln euro lub 4% światowego obrotu - w zależności od tego, która z tych kwot jest wyższa. Nieprzestrzeganie wszelkich innych wymogów lub obowiązków może skutkować grzywnami w wysokości do 10 milionów euro lub 2% światowego obrotu - w zależności od tego, która z tych kwot jest wyższa. Grzywny są zróżnicowane w zależności od naruszonego przepisu, przy czym zakazane praktyki podlegają najwyższym karom, a inne naruszenia podlegają niższym maksymalnym grzywnom.

Jakie środki wdraża unijna ustawa o sztucznej inteligencji konkretnie dla MŚP?

Unijna ustawa o sztucznej inteligencji ma na celu zapewnienie wsparcia dla MŚP i startupów, jak określono w art. 55. Konkretne środki obejmują przyznanie MŚP i startupom z siedzibą w UE priorytetowego dostępu do piaskownic regulacyjnych, jeśli spełnione są kryteria kwalifikowalności. Ponadto zorganizowane zostaną dostosowane działania w zakresie podnoszenia świadomości i rozwoju umiejętności cyfrowych, aby zaspokoić potrzeby mniejszych organizacji. Ponadto utworzone zostaną specjalne kanały komunikacji, aby oferować wskazówki i odpowiadać na pytania MŚP i startupów. Wspierany będzie również udział MŚP i innych zainteresowanych stron w procesie opracowywania norm. Aby zmniejszyć obciążenie finansowe związane z przestrzeganiem przepisów, opłaty za ocenę zgodności zostaną obniżone dla MŚP i startupów w oparciu o takie czynniki, jak etap rozwoju, wielkość i zapotrzebowanie rynku. Komisja będzie regularnie dokonywać przeglądu kosztów certyfikacji i zgodności dla MŚP/startupów (w oparciu o przejrzyste konsultacje) i współpracować z państwami członkowskimi w celu obniżenia tych kosztów tam, gdzie to możliwe.

Czy mogę dobrowolnie spełnić wymogi unijnej ustawy o sztucznej inteligencji, nawet jeśli mój system nie jest objęty jej zakresem?

Tak! Komisja, Urząd ds. AI lub państwa członkowskie będą zachęcać do stosowania dobrowolnych kodeksów postępowania w odniesieniu do wymogów określonych w tytule III rozdział 2 (np. zarządzanie ryzykiem, zarządzanie danymi i nadzór ludzki) w przypadku systemów AI, które nie są uznawane za systemy wysokiego ryzyka. Te kodeksy postępowania zapewnią rozwiązania techniczne dotyczące sposobu, w jaki system sztucznej inteligencji może spełnić wymogi, zgodnie z zamierzonym celem systemu. Uwzględnione zostaną inne cele, takie jak zrównoważony rozwój środowiska, dostępność, udział zainteresowanych stron i różnorodność zespołów programistycznych. Małe przedsiębiorstwa i startupy będą brane pod uwagę przy zachęcaniu do tworzenia kodeksów postępowania. Zob. art. 69 dotyczący kodeksów postępowania w zakresie dobrowolnego stosowania określonych wymogów.

Daj nam znać, jakich zasobów potrzebujesz

Szukamy 2-minutowych opinii na temat witryny AI Act, abyśmy mogli stworzyć zasoby, które będą dla Ciebie najbardziej pomocne. Wiele zasobów na naszej stronie internetowej stworzyliśmy w bezpośredniej odpowiedzi na opinie użytkowników, czasami w ciągu zaledwie 1-2 tygodni.

Ta strona istnieje w celu dostarczania pomocnych, obiektywnych informacji o wydarzeniach związanych z ustawą UE o sztucznej inteligencji. Korzysta z niej ponad 150 tys. użytkowników miesięcznie. Z góry dziękujemy za poświęcony czas i wysiłek – mamy nadzieję, że będziemy mogli się odwdzięczyć dostosowanymi, wysokiej jakości informacjami odpowiadającymi Twoim potrzebom.