In ihrer jüngsten Veröffentlichung über eine robuste europäische KI-Governance verfolgen Claudio Novelli, Philipp Hacker, Jessica Morley, Jarle Trondal und Luciano Floridi zwei Hauptziele: Sie erläutern den Governance-Rahmen des KI-Gesetzes und geben Empfehlungen für eine einheitliche und koordinierte Umsetzung (Novelli et al., 2024).

Im Folgenden wird ein selektiver Überblick über die Veröffentlichung gegeben, wobei der Schwerpunkt auf dem AI-Büro und GPAI liegt. Es ist wichtig anzumerken, dass dieser Überblick keine neuen Perspektiven einführt, sondern sich lediglich darauf konzentriert, die wichtigsten Ergebnisse der Publikation zu wiederholen, um sie für politische Entscheidungsträger verständlich und zugänglich zu machen.

Die Originalveröffentlichung ist bei SSRN über den SSRN-Link oder den DOI-Link verfügbar.

1. Umsetzung und Durchsetzung des AI-Gesetzes: die verbleibenden Schritte für die Kommission

| Wichtige Aspekte | Aufgaben und Zuständigkeiten der Kommission |

|---|---|

| a) Verfahren | - Einrichtung von und Zusammenarbeit mit dem AI-Büro und dem AI-Verwaltungsrat bei der Ausarbeitung von Durchführungs- und delegierten Rechtsakten - Durchführung des Komitologieverfahrens mit den Mitgliedstaaten für den Erlass und die Durchführung von Rechtsakten - Verwaltung des Erlasses delegierter Rechtsakte, Anhörung von Sachverständigen und Prüfung durch das EP und den Rat |

| b) Leitlinien | - Leitlinien für die Anwendung der Definition eines KI-Systems und der Klassifizierungsregeln für Hochrisikosysteme herausgeben - Risikobewertungsmethoden zur Ermittlung und Abschwächung von Risiken entwickeln - Regeln für "wesentliche Änderungen" definieren, die den Risikograd eines Hochrisikosystems verändern |

| c) Klassifizierung | - Aktualisierung von Anhang III, um Anwendungsfälle von KI-Systemen mit hohem Risiko durch delegierte Rechtsakte hinzuzufügen oder zu streichen - Einstufung von GPAI als "systemisches Risiko" auf der Grundlage von Kriterien wie FLOPs und Fähigkeiten mit großer Auswirkung - Anpassung der Regulierungsparameter (Schwellenwerte, Benchmarks) für die Einstufung von GPAI durch delegierte Rechtsakte |

| d) Verbotene Systeme | - Entwicklung von Leitlinien zu KI-Praktiken, die nach Artikel 5 verboten sind (AIA) - Festlegung von Standards und bewährten Praktiken, um manipulativen Techniken und Gefahren entgegenzuwirken - Festlegung von Kriterien für Ausnahmen von Verboten, z. B. für die Nutzung biometrischer Fernidentifizierung in Echtzeit durch die Strafverfolgungsbehörden |

| e) Harmonisierte Normen und risikoreiche Verpflichtungen | - Festlegung harmonisierter Standards und Verpflichtungen für Anbieter von Hochrisikosystemen, einschließlich eines internen Risikomanagementsystems(Artikel 9 AIA) - Standardisierung der Anforderungen an die technische Dokumentation und Aktualisierung von Anhang IV durch delegierte Rechtsakte, soweit erforderlich - Genehmigung von Verhaltenskodizes(Artikel 56 Absatz 6 AIA) |

| f) Information und Transparenz | - Festlegung von Informationspflichten für Anbieter von Hochrisikosystemen in der gesamten KI-Wertschöpfungskette - Herausgabe von Leitlinien zur Gewährleistung der Einhaltung der Transparenzanforderungen, insbesondere für GPAI |

| g) Durchsetzung | - Klärung des Zusammenspiels zwischen dem AIA und anderen EU-Rechtsrahmen - Regulierungssandboxen und Aufsichtsfunktionen - Überwachung der Festlegung von Sanktionen und Durchsetzungsmaßnahmen durch die Mitgliedstaaten, die wirksam, verhältnismäßig und abschreckend sind |

Kostenlos, unabhängig und hier, um zu bleiben.

Unser Ziel ist es, den nützlichsten, maßgeblichsten und umfassendsten Leitfaden zum AI Act im gesamten Internet zu erstellen. Wir werden diesen Leitfaden niemals hinter einer Paywall verstecken oder dazu nutzen, Ihnen eine Dienstleistung zu verkaufen. Wir tun dies, weil wir der Meinung sind, dass eine gute KI-Governance wichtig ist, und das bedeutet, dass maßgebliche Leitlinien wirklich für alle zugänglich sein müssen.

Wenn Sie uns unterstützen möchten, denken Sie bitte darüber nach, einen Gastbeitrag zu verfassen, um anderen zu helfen, das Gesetz zu verstehen und sich darin zurechtzufinden, oder senden Sie mir (Taylor, Design & Web Manager) Ihre Ideen und Ihr Feedback zur Website an: websites@futureoflife.org. Um auf dem Laufenden zu bleiben, abonnieren Sie unseren zweiwöchentlichen AI Act-Newsletter, die weltweit vertrauenswürdigste regelmäßige Publikation zum AI Act mit über 50.000 Abonnenten. Seit 2022 haben wir über 100 Updates veröffentlicht.

Diese Website wird vom Future of Life Institute erstellt und gepflegt – der weltweit ältesten und größten gemeinnützigen Organisation, die sich für eine verantwortungsvolle Entwicklung der KI einsetzt.

1.1 Leitlinien für die risikobasierte Klassifizierung von AI

- Im Rahmen der Risikobewertung muss die Kommission noch Regeln für "wesentliche Änderungen" festlegen, die das Risikoniveau eines Systems nach seiner Markteinführung verändern(Artikel 43 Absatz 4 AIA). Novelli et al. gehen davon aus, dass die standardmäßige Feinabstimmung von Fundamentmodellen nicht zu einer wesentlichen Änderung führen sollte, es sei denn, der Prozess beinhaltet ausdrücklich die Entfernung von Sicherheitsschichten oder andere Maßnahmen, die das Risiko eindeutig erhöhen.

- Ein ergänzender Ansatz für die Risikobewertung, den Novelli et al. vorschlagen, ist die Annahme von Plänen für das Änderungsmanagement, wie sie in der Medizin üblich sind; dabei handelt es sich um Dokumente, in denen die zu erwartenden Änderungen (z. B. Leistungsanpassungen, Änderung des Verwendungszwecks) und die Methoden zur Bewertung dieser Änderungen beschrieben werden.

1.2 Klassifizierung der allgemeinen KI (GPAI)

- Die Kommission hat im Rahmen des AIA die bemerkenswerte Befugnis, GPAI als "systemisch riskant" einzustufen(Artikel 51 AIA). Novelli et al. halten diese Unterscheidung für entscheidend: Nur GPAI mit systemischem Risiko unterliegen den weitreichenderen AI-Sicherheitsverpflichtungen in Bezug auf Bewertung und Red Teaming, umfassende Risikobewertung und -minderung, Meldung von Vorfällen und Cybersicherheit(Art. 55 AIA). Die Kommission kann die Entscheidung, eine GPAI als systemisch riskant einzustufen, initiieren oder als Reaktion auf eine Warnung des wissenschaftlichen Gremiums treffen.

- Die Kommission ist in der Lage, die Regulierungsparameter dynamisch anzupassen. Novelli et al. halten dies für ein robustes Governance-Modell für unverzichtbar, insbesondere weil der Trend in der KI-Entwicklung zu immer leistungsfähigeren, aber "kleineren" Modellen (die weniger FLOPs benötigen) geht.

- Artikel 52 legt fest, wie GPAI-Anbieter die Entscheidungen der Kommission zur Risikoeinstufung anfechten können. Novelli et al. gehen davon aus, dass dies ein Hauptstreitpunkt im Rahmen des KI-Gesetzes werden könnte. Es wird erwartet, dass GPAI-Anbieter, deren Modelle mit weniger als 10^25 FLOPs trainiert wurden, die aber von der Kommission als systemisch riskant eingestuft werden, Einspruch erheben können, möglicherweise bis zum Gerichtshof der Europäischen Union (EuGH). Dies ermöglicht es Anbietern mit tiefen Taschen, die Anwendung der strengeren Regeln zu verzögern. Gleichzeitig unterstreicht dies die Bedeutung der schnell veralteten 10^25 FLOP-Schwelle für GPAI.

1.3 Zeitplan für die Durchsetzung: Schonfrist und Ausnahmen

- Bestehenden GPAI-Systemen, die bereits auf dem Markt sind, wird eine Schonfrist von 24 Monaten gewährt, bevor sie dem AIA vollständig entsprechen müssen(Artikel 83 Absatz 3 AIA). Novelli et al. stellen fest, dass, was noch wichtiger ist, Hochrisikosysteme, die bereits 24 Monate nach dem Inkrafttreten auf dem Markt sind, vollständig vom AIA ausgenommen sind, bis "signifikante Änderungen" (definiert in Abschnitt 3.2) an ihrer Konstruktion vorgenommen werden(Art. 83(2) AIA). Sie machen geltend, dass dies wohl in einem tiefen Spannungsverhältnis zu einem Grundsatz des Produktsicherheitsrechts steht: Es gilt für alle auf dem Markt befindlichen Modelle, unabhängig davon, wann sie auf den Markt gekommen sind. Darüber hinaus begünstigen die Schonfrist für GPAI und die Ausnahmeregelung für bestehende Hochrisikosysteme die etablierten Unternehmen gegenüber neuen Marktteilnehmern, was aus wettbewerbsrechtlicher Sicht fragwürdig ist.

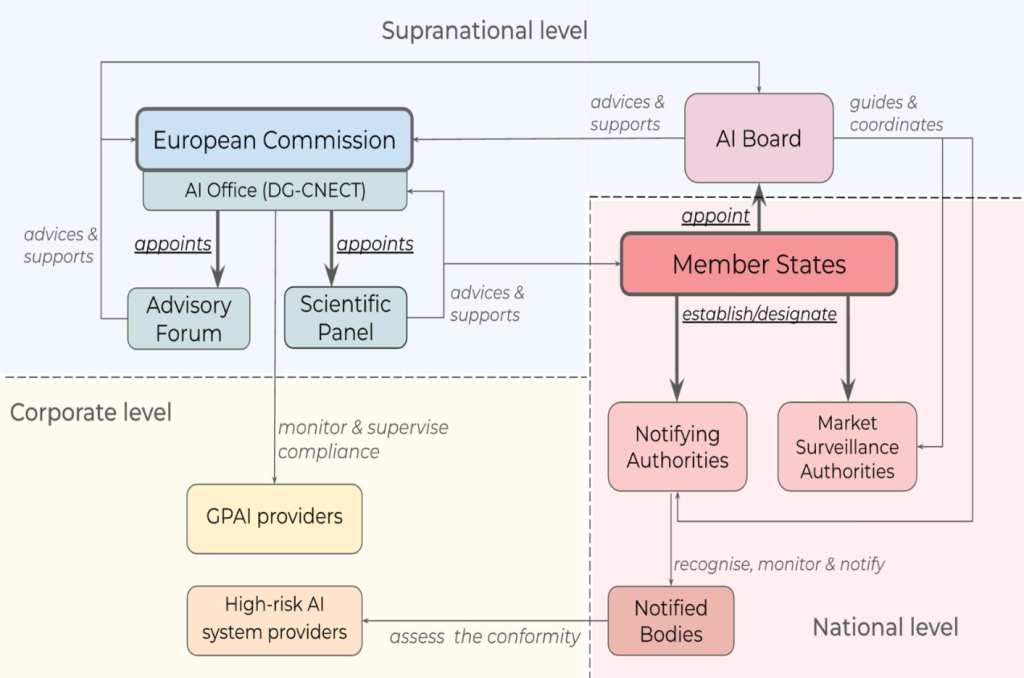

3. Supranationale Behörden: das AI-Büro, der AI-Vorstand und die anderen Gremien

| Institutionelle Einrichtung und Struktur | Auftrag und Aufgaben |

|---|---|

| AI-Büro (Artikel 64 AIA und Entscheidung der Kommission) Zentralisiert bei der GD-CNECT der Kommission | - EU-weite Harmonisierung der Umsetzung und Durchsetzung des AIA - Unterstützung von Durchführungs- und delegierten Rechtsakten - Standardisierung und bewährte Praktiken - Unterstützung bei der Einrichtung und dem Betrieb von Regulierungs-Sandkästen - Bewertung und Überwachung von GPAI und Unterstützung bei der Untersuchung von Regelverstößen - Administrative Unterstützung für andere Gremien (Verwaltungsrat, Beirat, wissenschaftliches Gremium) - Konsultation und Zusammenarbeit mit Interessengruppen - Zusammenarbeit mit anderen einschlägigen Generaldirektionen und Dienststellen der Kommission - Internationale Zusammenarbeit |

| AI-Vorstand (Art. 65 AIA) Vertreter aus jedem Mitgliedstaat, wobei das AI-Büro und der Europäische Datenschutzbeauftragte als Beobachter teilnehmen | - Erleichterung der kohärenten und wirksamen Anwendung des AIA - Koordinierung der zuständigen nationalen Behörden - Harmonisierung der Verwaltungspraktiken - Abgabe von Empfehlungen und Stellungnahmen (auf Ersuchen der Kommission) - Unterstützung der Einrichtung und des Betriebs von Regulierungs-Sandkästen - Sammlung von Rückmeldungen zu GPAI-bezogenen Warnmeldungen |

| Beratungsgremium (Artikel 67 AIA) Von der Kommission ernannte Interessenvertreter | - Bereitstellung von technischem Fachwissen - Ausarbeitung von Stellungnahmen und Empfehlungen (auf Ersuchen des Verwaltungsrats und der Kommission) - Einsetzung von Untergruppen zur Prüfung spezifischer Fragen - Erstellung eines Jahresberichts über die Tätigkeiten |

| Wissenschaftliches Gremium (Artikel 68 AIA) Von der Kommission ausgewählte unabhängige Sachverständige | - Unterstützung bei der Durchsetzung der KI-Regulierung, insbesondere für GPAI - Beratung bei der Klassifizierung von KI-Modellen mit Systemrisiko - Alarmierung des KI-Büros bei Systemrisiken - Entwicklung von Bewertungsinstrumenten und -methoden für GPAI - Unterstützung von Marktaufsichtsbehörden und grenzüberschreitenden Aktivitäten |

| Notifizierende Behörden (Artt 28-29 AIA) Von den Mitgliedstaaten benannt oder eingerichtet | - Bearbeitung der Notifizierungsanträge von Konformitätsbewertungsstellen (KBS) - Überwachung der KBS - Zusammenarbeit mit Behörden anderer Mitgliedstaaten - Vermeidung von Interessenkonflikten mit Konformitätsbewertungsstellen - Vermeidung von Interessenkonflikten und Unparteilichkeit der Bewertung |

| Benannte Stellen (Artt 29-38 AIA) Eine unabhängige Konformitätsbewertungsstelle (mit Rechtspersönlichkeit), die nach dem AIA benannt ist | - Überprüfung der Konformität von AI-Systemen mit hohem Risiko - Ausstellung von Zertifizierungen - Verwaltung und Dokumentation von Unterauftragsvereinbarungen - Regelmäßige Bewertungsaktivitäten (Audits) - Teilnahme an Koordinierungsaktivitäten und europäischer Normung |

| Marktüberwachungsbehörden (Artt 70-72 AIA) Einrichtungen, die von den Mitgliedstaaten als einheitliche Ansprechpartner benannt oder eingerichtet wurden | - Untersuchung der Nichteinhaltung und Korrektur von KI-Systemen mit hohem Risiko (z. B. Risikomaßnahmen) - Überwachung von Praxistests und Verwaltung von Berichten über schwerwiegende Zwischenfälle - Anleitung und Beratung bei der Umsetzung der Verordnung, insbesondere für KMU und Start-ups - Unterstützung von Verbraucherschutz und fairem Wettbewerb |

3.1 Das AI-Büro

1. Institutionelle Zusammensetzung und operative Autonomie

- Novelli et al. stellen fest, dass die genaue Organisationsstruktur und operative Autonomie des Amtes unklar bleiben. Weder im AIA noch in der Entscheidung der Kommission wurden Bestimmungen über die Zusammensetzung des Amtes für künstliche Intelligenz, die Dynamik seiner Zusammenarbeit mit den verschiedenen Verbindungsstellen innerhalb der GD oder das Ausmaß seiner operationellen Autonomie festgelegt. Novelli et al. stellen die Hypothese auf, dass dieses Fehlen wahrscheinlich durch die Erwartung gerechtfertigt ist, dass das Amt teilweise die bestehende Infrastruktur der GD-CNECT nutzen wird. Novelli et al. betonen jedoch, dass die Einstellung von Experten und die Bereitstellung umfangreicher Finanzmittel eine große Herausforderung darstellen werden, da das Amt mit einigen der bestfinanzierten Privatunternehmen der Welt konkurrieren wird.

- Was die operationelle Autonomie des Amtes betrifft, so bedeutet seine Eingliederung in die GD-CNECT, dass der Managementplan der GD die strategischen Prioritäten des AI-Büros bestimmt. Novelli et al. stellen fest, dass diese Integration direkten Einfluss auf den Umfang und die Richtung der Initiativen des AI-Büros hat.

2. Auftrag(e) und Aufgabe

- Die Hauptaufgabe des KI-Büros besteht laut Kommissionsbeschluss darin, die harmonisierte Umsetzung und Durchsetzung des AIA sicherzustellen (Artikel 2, Punkt 1 des Beschlusses). Die Entscheidung umreißt auch zusätzliche Aufgaben, wie die Verbesserung eines strategischen EU-Ansatzes für globale KI-"Initiativen", die Förderung von Maßnahmen, die den sozialen und wirtschaftlichen Nutzen von KI maximieren, die Unterstützung von KI-Systemen, die die Wettbewerbsfähigkeit der EU steigern, und die Beobachtung von Fortschritten auf dem KI-Markt.

- Novelli et al. halten diese Formulierung für sehr weit gefasst. Eine von ihnen vorgeschlagene Interpretation ist, dass die Rolle des KI-Büros über den Anwendungsbereich des AIA hinausgehen und zusätzliche normative Rahmenwerke für KI umfassen könnte (wie die überarbeitete Produkthaftungsrichtlinie oder die Richtlinie über die Haftung für künstliche Intelligenz (AILD)). In diesem Fall, so stellen Novelli et al. fest, müsste das Amt möglicherweise in eine autonomere Einrichtung umstrukturiert werden, wie das CERT-EU, was eine Herauslösung aus dem administrativen Rahmen der Kommission erforderlich machen könnte.

- Novelli et al. halten die Unklarheit des derzeitigen normativen Rahmens in Bezug auf den Atem und den Aufgabenbereich des Amtes für künstliche Intelligenz für einen entscheidenden Aspekt. Sie sind der Ansicht, dass die dem Amt für künstliche Intelligenz zugewiesenen Zuständigkeiten weit gefasst sind, wobei sie davon ausgehen, dass sich ihre genaue Umsetzung auf der Grundlage praktischer Erfahrungen weiterentwickeln wird.

- Ein wichtiger Aspekt, der im Zusammenhang mit dem Tätigkeitsbereich des Amtes zu berücksichtigen ist, ist die Art seiner Entscheidungen. Novelli et al. stellen fest, dass das AI-Büro keine eigenen verbindlichen Entscheidungen erlässt, sondern die Kommission unterstützt und berät. Sie geben zu bedenken, dass die Wirksamkeit von Mechanismen zur Anfechtung von Kommissionsentscheidungen durch die undurchsichtige Art der Unterstützung der Kommission durch das AI-Büro, seine Interaktionen innerhalb der GD-CNECT und seine Beziehungen zu externen Stellen, wie z. B. nationalen Behörden, beeinträchtigt werden könnte. Novelli et al. halten dieses Problem angesichts der Zusammenarbeit des AI-Büros mit externen Experten und Interessengruppen für besonders relevant. Sie betonen, dass die Dokumentation und Offenlegung der Beiträge des AI-Büros von entscheidender Bedeutung sind.

3.2 Der AI-Vorstand, das Beratungsgremium und das wissenschaftliche Gremium

1. Strukturen, Aufgaben und Zusammensetzung der drei Organe

- Für Novelli et al. wirft die Tatsache, dass es drei separate Einrichtungen mit relativ ähnlicher Zusammensetzung gibt, Fragen auf. Es ist verständlich, dass der AI-Vorstand die Vertretung und eine gewisse Unabhängigkeit von den EU-Institutionen gewährleisten soll. Aber warum es sowohl ein Beratungsgremium als auch ein wissenschaftliches Gremium gibt, ist nicht ersichtlich. Das Forum ist für verschiedene Perspektiven der Zivilgesellschaft und der Industrie gedacht und fungiert im Wesentlichen als eine institutionalisierte Form der Lobbyarbeit, wobei kommerzielle und nichtkommerzielle Interessen ausgeglichen werden. Im Gegensatz dazu besteht das Gremium aus unabhängigen und (hoffentlich) unvoreingenommenen Experten, die spezifische Aufgaben im Zusammenhang mit GPAI haben.

2. Auftrag(e) und Aufgaben

- Novelli et al. stellen fest, dass der Ausschuss nicht befugt ist, Entscheidungen der nationalen Aufsichtsbehörden zu revidieren. Sie sind der Ansicht, dass sich dies als eindeutiger Nachteil erweisen könnte, da es die einheitliche Anwendung des Gesetzes behindert, wenn bestimmte Mitgliedstaaten den AIA auf sehr eigenwillige Weise auslegen. Man denke beispielsweise an die Überwachung der Beschränkungen für Überwachungsinstrumente, die eine biometrische Fernidentifizierung nutzen.

- Novelli et al. sind der Ansicht, dass die Unterscheidung zwischen dem Beirat und dem wissenschaftlichen Gremium weniger klar ist als die Trennung zwischen dem Vorstand und dem Amt. Sie werfen die Frage auf, inwieweit das Gremium ausschließlich den Vorstand und die Kommission unterstützt, da das Gremium ausschließlich das AI-Büro direkt unterstützt, und ob das spezielle GPAI-Fachwissen des Gremiums diesen Einrichtungen zugute kommen könnte. Die Teilnahme des AI-Büros an den Sitzungen des Verwaltungsrats ist ein indirekter Kanal, über den das Fachwissen des Gremiums breitere Diskussionen beeinflussen kann, aber Novelli et al. halten diese Regelung für nicht ganz zufriedenstellend. Das Fachgutachten des Gremiums könnte an Einfluss verlieren, da das AI-Büro in den Vorstandssitzungen kein Stimmrecht hat.

4. Empfehlungen für eine solide Governance des AI-Gesetzes

Aufbauend auf ihrer Analyse sehen Novelli et al. die folgenden wichtigen Aktualisierungen vor, die an der Governance-Struktur des AI-Gesetzes vorgenommen werden sollten.

4.1 Klärung des institutionellen Aufbaus des AI-Büros

- In Anbetracht des breiten Aufgabenspektrums, das für das AI-Büro vorgesehen ist, ist eine detailliertere organisatorische Anleitung erforderlich. Darüber hinaus ist das Mandat des Amtes hinsichtlich der Kriterien für die Auswahl der Sachverständigen, die die Bewertungen durchführen sollen, nicht spezifisch genug(Erwägungsgrund 164 AIA).

- Die Eingliederung des AI-Büros in den Rahmen der Kommission könnte seine operative Transparenz beeinträchtigen, da es verpflichtet ist, die allgemeine Kommunikations- und Vertraulichkeitspolitik der Kommission einzuhalten. So enthält beispielsweise das Recht auf Zugang der Öffentlichkeit zu Kommissionsdokumenten (Verordnung (EG) Nr. 1049/2001) zahlreiche Ausnahmen, die die Freigabe von Dokumenten im Zusammenhang mit dem AI-Büro behindern könnten. Novelli et al. nennen die Ausnahme von Dokumenten, die "[...] die geschäftlichen Interessen einer natürlichen oder juristischen Person, einschließlich des geistigen Eigentums", beeinträchtigen würden, eine weit gefasste Bestimmung, der es an spezifischen, durchsetzbaren Grenzen fehlt. Eine engere Auslegung dieser Ausnahmen könnte auf das AI-Büro angewandt werden, um Transparenzprobleme zu umgehen.

- Die operative Autonomie des AI-Büros muss weiter geklärt werden. Novelli et al. schlagen vor, dass dies in Form von Leitlinien für die Entscheidungsbefugnis, die finanzielle Unabhängigkeit und die Fähigkeit zur Zusammenarbeit mit externen Parteien geschehen könnte.

- Ein alternativer, potenziell effektiverer Ansatz wäre die Einrichtung des AI-Büros als dezentralisierte Agentur mit eigener Rechtspersönlichkeit, wie die EFSA und die EMA. Dieses Modell würde das AI-Büro mit größerer Autonomie ausstatten, einschließlich relativer Freiheit von den politischen Agenden auf Kommissionsebene, einem definierten Auftrag, Exekutivbefugnissen und der Befugnis, verbindliche Entscheidungen zu treffen. Novelli et al. sehen ein gewisses Risiko des Abdriftens der Agenturen, weisen aber darauf hin, dass die empirischen Daten darauf hindeuten, dass die Hauptansprechpartner der EU-Agenturen die "übergeordneten" GDs der Kommission sind.

4.2 Zusammenlegung des Forums und des Gremiums zu einem einzigen Gremium

- Novelli et al. argumentieren, dass die Zusammenlegung des Forums und des Gremiums zu einer einzigen Einrichtung Doppelarbeit vermeiden und den Beratungsprozess vor der Entscheidungsfindung stärken würde. Diese kombinierte Einrichtung würde die Wissensbasis der Zivilgesellschaft, des Wirtschaftssektors und der akademischen Gemeinschaft zusammenführen, was laut Novelli et al. eine integrative und reflektierte Diskussion über die von der Kommission ermittelten Bedürfnisse fördern würde. Sie kommen zu dem Schluss, dass dieser Ansatz die Qualität der Beratung des Verwaltungsrats, des Amtes und der anderen EU-Organe und -Agenturen erheblich verbessern könnte.

- Sollte sich eine Zusammenlegung des Forums und des Gremiums als undurchführbar erweisen, könnte eine alternative Lösung darin bestehen, ihre Tätigkeiten besser zu koordinieren, und zwar durch eine klare Trennung der Bereiche, Rollen und Aufgaben, aber eine einheitliche Berichterstattung. Novelli et al. schlagen die Erstellung eines gemeinsamen Jahresberichts vor, in dem die Beiträge des Forums und des Gremiums zusammengefasst werden, um administrative Überschneidungen zu vermeiden und der Kommission, dem Verwaltungsrat und den Mitgliedstaaten eine einheitlichere Stimme zu verleihen.

- Die Zusammenlegung oder Verbesserung der Koordinierung zwischen dem Forum und dem Gremium begünstigt eine solide Führung des AIA durch die Straffung der Beratungsfunktionen im Hinblick auf Flexibilität und Innovation, auch als Reaktion auf disruptive technologische Veränderungen.

4.3 Koordinierung sich überschneidender EU-Einheiten: Argumente für eine KI-Koordinierungsstelle

- Mit der zunehmenden Verbreitung von KI-Technologien in der EU wird die Zusammenarbeit zwischen den Aufsichtsbehörden immer wichtiger, insbesondere wenn die Einführung neuer KI-Anwendungen mit gegensätzlichen Interessen kollidiert. Ein Beispiel hierfür ist die Entscheidung der italienischen Datenschutzbehörde, ChatGPT auszusetzen. Novelli et al. halten es für entscheidend, effiziente Koordinierungsmechanismen in den EU-Rechtsrahmen einzubauen.

- Darüber hinaus sehen sie in der Einrichtung einer zentralen Plattform, des European Union Artificial Intelligence Coordination Hub (EU AICH), eine überzeugende Alternative. Novelli et al. argumentieren, dass die Einrichtung einer solchen Drehscheibe die Einheitlichkeit der AIA-Durchsetzung deutlich erhöhen und gleichzeitig die operative Effizienz verbessern und Unstimmigkeiten bei der Behandlung ähnlicher Angelegenheiten verringern wird.

4.4 Kontrolle des KI-Missbrauchs auf EU-Ebene

- Die fehlende Befugnis des Ausschusses für künstliche Intelligenz, Entscheidungen der nationalen Behörden zu revidieren oder zu korrigieren, stellt eine bemerkenswerte Lücke bei der Gewährleistung einheitlicher KI-Vorschriften dar. Dies ist bedenklich, insbesondere im Hinblick auf die Einschränkungen des AIA für Überwachungsinstrumente, einschließlich Gesichtserkennungstechnologien.

- Ohne die Möglichkeit, nationale Entscheidungen zu korrigieren oder zu harmonisieren, besteht ein erhöhtes Risiko, dass KI in einigen Mitgliedstaaten missbräuchlich eingesetzt wird, was die Einrichtung illiberaler Überwachungssysteme erleichtern und legitime abweichende Meinungen unterdrücken könnte. Novelli et al. unterstreichen die Notwendigkeit eines Mechanismus innerhalb des KI-Ausschusses, um eine einheitliche Rechtsdurchsetzung zu gewährleisten und missbräuchliche Anwendungen von KI zu verhindern, insbesondere in sensiblen Bereichen wie der biometrischen Überwachung.

4.5 Lernmechanismen

- Angesichts ihrer Fähigkeit zur schnelleren Entwicklung und Anpassung sehen Novelli et al. die Agilität nicht-legislativer Akte als Chance für eine reaktionsfähige Governance in der KI. Sie weisen jedoch darauf hin, dass die Agilität des Rechtsrahmens mit der Anpassungsfähigkeit der Regulierungsbehörden abgestimmt werden muss. Mechanismen des Lernens und der Zusammenarbeit zwischen und innerhalb von Behörden sind für die Bewältigung der vielschichtigen technischen und gesellschaftlichen Herausforderungen der KI von wesentlicher Bedeutung. Sie schlagen vor, dass spezifische Ex-ante- und Ex-post-Überprüfungsverpflichtungen eingeführt werden könnten.

- Noch wichtiger ist, dass Novelli et al. vorschlagen, dass ein spezielles Referat, z. B. innerhalb des AI-Büros, damit beauftragt werden sollte, die besten und schlechtesten Praktiken in allen beteiligten Einrichtungen (vom Büro bis zum Forum) zu ermitteln. In Zusammenarbeit mit den Kompetenzzentren der Mitgliedstaaten könnte eine solche Stelle zu einer Drehscheibe für institutionelles und individuelles Lernen und die Weiterentwicklung von AI innerhalb und außerhalb des AIA-Rahmens werden.

Referenzen

Novelli, Claudio und Hacker, Philipp und Morley, Jessica und Trondal, Jarle und Floridi, Luciano, A Robust Governance for the AI Act: AI Office, AI Board, Scientific Panel, and National Authorities (5. Mai 2024). Verfügbar bei SSRN: https: //ssrn.com/abstract=4817755 oder http://dx.doi.org/10.2139/ssrn.4817755